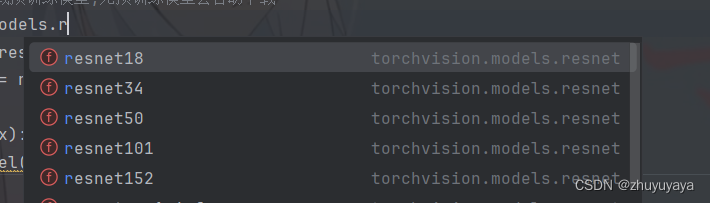

本文介绍: 在PyTorch中,nn.X都有对应的函数版本F.X,但是并不是所有的F.X均可以用于forward或其它代码段中,因为当网络模型训练完毕存储model时,forward中的F.X函数中的参数是无法保存的。也就是说,在forward中,使用的F.X函数一般均没有状态参数。nn.ReLU()创建一个nn.Module,这意味着你可以添加到nn.Sequential中。而nn.functional.relu只是对 relu 函数API的调用。一般来说,用模块还是简单的函数调用,取决于你的编码风格。

先来看看nn.ReLU的源码,可以看到其实在forward中nn.relu是调用了F.relu函数的:

nn.ReLU()创建一个nn.Module,这意味着你可以添加到nn.Sequential中。而nn.functional.relu只是对 relu 函数API的调用。一般来说,用模块还是简单的函数调用,取决于你的编码风格。

在PyTorch中,nn.X都有对应的函数版本F.X,但是并不是所有的F.X均可以用于forward或其它代码段中,因为当网络模型训练完毕存储model时,forward中的F.X函数中的参数是无法保存的。也就是说,在forward中,使用的F.X函数一般均没有状态参数。

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。