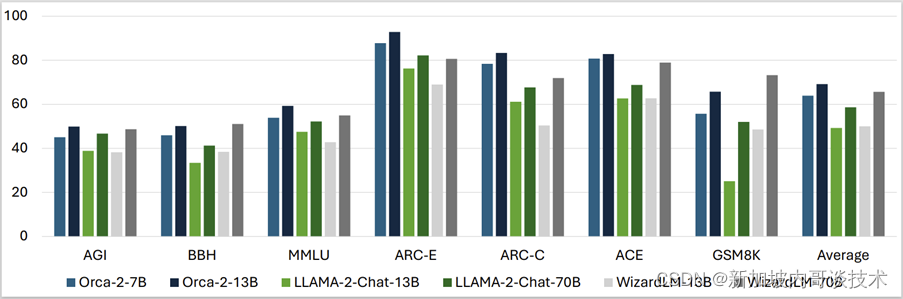

尽管全球目睹了OpenAI的权力斗争和大规模辞职,但作为AI领域的长期支持者,微软并没有放慢自己的人工智能努力。今天,由萨提亚·纳德拉领导的公司研究部门发布了Orca 2,这是一对小型语言模型,它们在零样本设置下对复杂推理任务的测试中,要么匹敌要么超越了体积是它们五到十倍的大型语言模型,包括Meta的Llama-2 Chat-70B。

这些模型分别具有70亿和130亿参数,是在几个月前展示了通过模仿更大、更有能力模型的逐步推理轨迹而展现出强大推理能力的原始13B Orca模型工作的基础上构建的。

微软的研究人员在一篇联合博客文章中写道:“通过Orca 2,我们继续展示改进的训练信号和方法可以让小型语言模型实现更强的推理能力,这通常只在更大的语言模型中找到。”

公司已经开源了这两个新模型,以进一步研究小型模型的开发和评估,这些模型可以像更大的模型一样表现出色。这项工作可以为企业(特别是资源有限的企业)提供更好的选择,以应对其目标用例,而无需在计算能力上投入过多。

了解更多 教小型模型如何推理 虽然像GPT-4这样的大型语言模型长期以来一直以其推理能力和解释复杂问题的能力给企业和个人留下深刻印象,但它们的小型对应物大多缺乏这种能力。微软研究院决定通过对Llama 2基础模型进行微调来解决这一差距,使用高度定制的合成数据集。然而,研究人员训练小型模型采用不同的解决策略来应对不同的任务,而不是训练模型去复制更有能力模型的行为——这是一种常用的模仿学习技术。这个想法是,更大模型的策略可能并不总是适用于小型模型。例如,GPT-4可能能够直接回答复杂的问题,但一个小型模型在没有那种能力的情况下,可能会受益于将同一任务分解成几个步骤。

研究人员在今天发表的一篇论文中写道:“在Orca 2中,我们教授模型各种推理技术(逐步、回忆然后生成、回忆-推理-生成、直接回答等)。更重要的是,我们旨在帮助模型学会确定每项任务最有效的解决策略。”该项目的培训数据是从一款更有能力的教师模型中获取的,以这样的方式教导学生模型处理两个方面:如何使用推理策略以及何时准确地使用它来处理手头的任务。